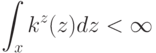

Чему способствует уменьшение параметра  ?

?

(Ответ считается верным, если отмечены все правильные варианты ответов.)

Варианты ответа

к ошибке всей композиции.

переобучению;(Верный ответ)

росту числа ошибок;

росту числа базовых алгоритмов;(Верный ответ)

![k(z)=[z=0]](https://intuit.ru//sites/default/files/tex_cache/fe7e5eed6dff0327f0a1f35d60ccef70.png)