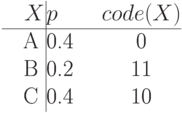

Вычислить

ML1(X) для блочного кода Хаффмена для

X. Длина блока - 2 бита:

Дискретная случайная величина X может принимать три различных значения. Если считать сложность построения кода пропорциональной количеству различных значений кодируемой дискретной случайной величины, то блочный код для X по сравнению с неблочным сложнее строить в:

Определить характер зависимости между X1 и Z, если задана дискретная случайная величина Z=(X1+1)2-X2, где независимые дискретные случайные величины X1, X2 могут с равной вероятностью принимать значение либо 0, либо 1:

Определить HZ, если задана дискретная случайная величина Z=(X1+1)2-X2, где независимые дискретные случайные величины X1, X2 могут с равной вероятностью принимать значение либо 0, либо 1:

Определить HX1, если задана дискретная случайная величина Z=(X1+1)2-X_2, где независимые дискретные случайные величины X1, X_2 могут с равной вероятностью принимать значение либо 0, либо 1:

Дискретные случайные величины X1 и X2 определяются подбрасыванием двух идеальных тетраэдров, грани которых помечены числами от 1 до 4. Дискретная случайная величина Y равна сумме чисел, выпавших при подбрасывании этих тетраэдров, т.е. Y=X1+X2. Вычислить I(X1,Y):

Дискретные случайные величины X1 и X2 определяются подбрасыванием двух идеальных тетраэдров, грани которых помечены числами от 1 до 4. Дискретная случайная величина Y равна сумме чисел, выпавших при подбрасывании этих тетраэдров, т.е. Y=X1+X2. Вычислить HY:

Значения дискретной случайной величины X1 и X2 определяются подбрасыванием двух идеальных монет, а дискретная случайная величина Y равна сумме количества "гербов", выпавших при подбрасывании этих монет. В Y содержится:

Про дискретную случайную величину X известно, что ее значениями являются буквы кириллицы. Произведен ряд последовательных измерений X, результат которых - "ТЕОРИЯИНФОРМАЦИИ". Составить на основании этого результата приблизительный закон распределения вероятностей этой дискретной случайной величины и оценить минимальную среднюю длину кодов для X:

Если дискретные случайные величины X и Y заданы законами распределения P(X=Xi)=pi, P(Y=Yj)=qj и совместным распределением P(X=Xi,Y=Yj)=pij, то количество информации, содержащейся в X относительно Y равно:

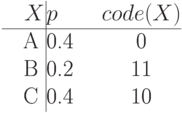

Вычислить

Вычислить